Учёные из Америки продемонстрировали умение нейросети создавать ключи, способные обмануть систему, работающую по принципу определения отпечатков пальцев. С помощью фальшивых отпечатков систему удавалось провести каждый пятый раз.

Научили искусственный интеллект нехорошему пятеро учёных из университетов Нью-Йорка и Мичигана. Создание поддельных отпечатков стало возможным благодаря двум факторам. Во-первых, биометрика, как правило, считывает лишь часть отпечатка пальца – ту, которую прикладывают к сканеру. А она, в отличие от всего отпечатка, может совпадать с другими. Получается, что искусственный отпечаток может соответствовать разным частям сразу нескольких отпечатков. Во-вторых, ИИ научился находить такие варианты, которые наиболее распространены.

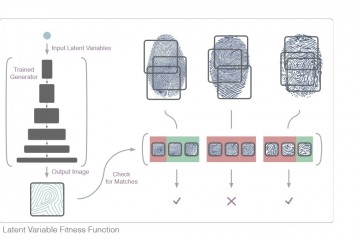

Два этих фактора позволяют нейросети создавать отпечатки, сходные с большим количеством реальных и подбирать нужный. Это похоже на хакерскую атаку с подбором пароля.

Учёные утверждают, что их исследование поможет сделать биометрические системы совершеннее.

О возможном использовании ИИ преступниками говорят не в первый раз. Не далее, как в феврале специалисты по кибербезопасности уже поднимали эту проблему, зачитывая доклады на тему преступного использования ИИ.